AI 모델 모니터링, 성능·편향·비용을 동시에 잡는 8가지 핵심

왜 지금, AI 모델 모니터링이 중요한가

- AI 모델 모니터링은 배포 이후의 현실 데이터를 지켜보며 성능, 편향, 비용, 안정성을 지속적으로 관리하는 프레임이에요. 개발 단계의 높은 점수만으로는 실제 서비스 품질을 보장하기 어렵죠.

- 데이터 분포 변화(드리프트), 사용자 행태 변화, 인프라 병목, 규제 요구 등은 시간이 지날수록 누적돼요. 그래서 AI 모델 모니터링 대시보드와 자동 알람, 롤백/그레이드 릴리스 전략이 필수입니다.

- 조직 차원에선 공통 지표(SLO)와 대응 룰을 정해 두면 장애 비용을 크게 줄일 수 있어요. 참고로 관련 흐름은 아래 카테고리에서도 꾸준히 다루고 있어요. AI 카테고리 살펴보기

8가지 필수 체크포인트

1) 성능 드리프트(Accuracy·F1·RMSE)

- 학습 당시 분포와 운영 데이터의 차이로 예측 품질이 서서히 하락해요. AI 모델 모니터링에선 세그먼트별(지역·디바이스·시간대) 성능을 분리 관측해 이상을 빨리 잡아야 합니다.

- 지표: 분류는 Accuracy/F1, 회귀는 RMSE/MAE, 순위는 NDCG/MRR. 신뢰 구간과 샘플 수를 함께 기록하세요.

- 대응: 성능 임계치 하회 시 핫픽스(피처 차단), 이전 버전 롤백, 데이터 증강/재학습 배치. MLOps 블루프린트

2) 데이터/피처 분포 변동(PSI·KL Divergence)

- 입력 분포가 바뀌면 모델이 엉뚱한 영역에서 작동할 수 있어요. Population Stability Index(PSI)나 KL Divergence로 드리프트를 계산해 파이프라인 단계별로 표지판을 세우세요.

- 지표: PSI 0.1~0.25 경고, 0.25 이상은 재학습 고려. 범주형은 토큰 빈도 Top-N 추이로, 수치형은 분위수 이동으로 보조 점검.

- 대응: 스키마 검증, 결측/이상치 비율 상한, 샘플링 리플레이 테스트. 데이터 파이프라인 사고 사례

3) LLM 품질·지연(Latency·Token·거절률)

- 생성형에서의 AI 모델 모니터링은 응답 품질 평가와 지연(P50/P95/P99), 토큰 사용량을 함께 봐야 정확도와 비용 균형을 맞출 수 있어요.

- 지표: 컨텍스트 사용률, 거절률, 금칙어 필터 적중률, 사용자 수정 비율, 재질문 빈도.

- 대응: 프롬프트 버전 관리, 캐시/리트라이, 함수 호출 제약, 평가 데이터셋으로 주기적 오프라인 점검.

4) 편향/공정성(Fairness)

- 데모그래픽 그룹별 성능 격차를 측정해 불합리한 차별을 줄여야 해요. Equalized Odds, Demographic Parity 차이를 추적하고, 영향이 크면 가중 재학습/후처리를 고려하세요.

- 대응: KPI에 공정성 지표를 포함하고, 실험·배포·감사 로그를 보관. 관련 이슈는 업계 뉴스도 참고해 인사이트를 넓혀보세요. 관련 뉴스 보기

5) 안전/보안(Safety·PII·Jailbreak)

- 프롬프트 주입, Jailbreak 시도, 개인정보(PII) 누출을 막기 위한 정책 필터와 레드팀 테스트가 필요해요. AI 모델 모니터링 지표에 정책 차단 건수와 오탐/미탐 비율을 추가하세요.

- 대응: 입력/출력 컨텐츠 규칙, 서명·비밀키 마스킹, 샌드박스 도구 사용. 개념 이해는 기본 지식 섹션에서 계속 보강하세요. 기초 지식 더 보기

6) 비용/효율(Token·GPU·캐싱)

- 토큰/쿼리당 비용, GPU 사용률, 캐시 히트율을 추적해 품질 손상 없이 지출을 최적화하세요. AI 모델 모니터링에서 비용 알람은 사업성 보호 장치예요.

- 대응: 프롬프트 압축, 지식검색(RAG) 캐시, 배치 추론, 혼합 정밀도. 클라우드 가이드는 아래 문서를 참고하면 좋아요. 클라우드 최적화 가이드

7) 운영 안정성(SLO·에러율·장애대응)

- 지연·에러·타임아웃의 서비스 레벨 목표(SLO)를 정의하고, 배포 전후의 변화 폭을 추적하세요. AI 모델 모니터링은 모델 품질뿐 아니라 시스템 신뢰성도 함께 다룹니다.

- 대응: 캔리 릴리스, 피처 플래그, 자동 롤백, 온콜 룰. 현업 이슈는 커뮤니티 기사로도 감을 맞춰보세요. 업계 뉴스

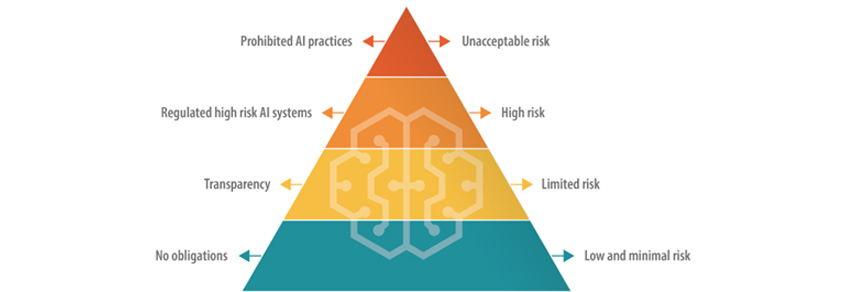

8) 거버넌스/감사(Model Card·Lineage)

- 모델 카드, 데이터/피처 계보(Lineage), 실험/배포 이력을 남겨 규제·감사 요구에 대비하세요. AI 모델 모니터링과 거버넌스가 연결되면 재현 가능한 운영이 가능해져요.

- 참고: 클라우드 파이프라인으로 거버넌스를 엮으면 확장성이 좋아집니다. 클라우드 인사이트

핵심 지표 요약표

| 체크 영역 | 대표 지표 | 자동화 트리거 |

| 성능 | Accuracy/F1, RMSE, NDCG | 임계 하회 → 롤백 또는 재학습 배치 |

| 데이터 | PSI, 결측/이상치 비율 | PSI ≥ 0.25 → 스키마 검증/피처 차단 |

| LLM | P95 지연, 토큰/요청, 거절률 | 지연 급등 → 캐시/리트라이/템플릿 교체 |

| 편향 | EO/DP 격차, 그룹별 F1 | 격차 확대 → 재가중/후처리 적용 |

| 안전 | 정책 차단/오탐/미탐 | 차단 급증 → 규칙 보정/레드팀 추가 |

| 비용 | 원가/요청, GPU Util, 캐시율 | 원가 초과 → 프롬프트 압축/배치 추론 |

| 안정성 | 에러율, 타임아웃, SLO | SLO 위반 → 자동 롤백/플래그 오프 |

| 거버넌스 | 모델 카드/Lineage 완전성 | 누락 발견 → 배포 차단/문서 보완 |

- 표의 항목을 팀 KPI와 연결하면 경영진 보고도 명확해져요. 더 넓은 트렌드 해석은 내부 섹션에서 이어보세요. 트렌드 해석 바로가기

설계 팁: 작은 시작, 빠른 학습

- 기본부터: 로그 표준화(요청 ID, 모델/프롬프트 버전, 사용자 세그먼트), 샘플링 규칙, 개인정보 비식별을 먼저 잡으세요. 이것만으로도 AI 모델 모니터링 품질이 급상승해요.

- 평가 데이터셋: 주·월 단위 리프레시. 비즈니스 중요 사례를 더해 회귀 테스트로 누락을 방지하세요.

- 관측 가능성: 추론 전/후 이벤트 훅으로 피처·메타데이터·결과 로그를 결합해 원인 분석 시간을 단축합니다.

- 릴리스 전략: 그레이드 롤아웃, A/B, 섀도 배치를 규칙으로 고정하세요. 참고 기사도 가볍게 훑어보면 좋아요. 릴리스 이슈 읽기

모니터링 스택 예시

- 수집: API 게이트웨이/미들웨어에서 요청·응답·메타데이터 스트리밍.

- 피처/모델 관리: 피처 스토어, 모델 레지스트리, 실험 추적.

- 관측/알람: 로그·메트릭·트레이스 통합, 규칙 기반/이상탐지 알림.

- 거버넌스: 모델 카드 자동 생성, 데이터 계보 시각화. 아키텍처 참고는 아래 문서를 확인해 보세요. GenAI MLOps 참고

알람·대응 규칙 설계

- 다중 조건: 단일 지표 임계치보다 “성능 하락 + PSI 급등 + 지연 증가” 같은 조합 트리거가 오탐을 줄입니다.

- 시간 창: 5분·1시간·1일 창을 모두 봐 단기 스파이크와 장기 추세를 동시에 포착하세요.

- 행동 자동화: 경고 레벨에 따라 프롬프트 교체, 피처 차단, 트래픽 셰이핑을 자동 실행.

- 사후 회고: 장애마다 타임라인·원인·재발 방지안을 템플릿으로 남겨 누적 학습을 만드세요. 사례 더 보기

측정 가능한 것은 개선 가능하다. — AI 모델 모니터링의 첫 원칙

7일 구축 로드맵(예시)

- 비즈니스 KPI와 연결된 핵심 지표 정의(성능, 비용, 안정성, 편향).

- 로그 스키마 표준화 및 개인정보 비식별 룰 확정.

- 베이스 대시보드(성능·PSI·지연·토큰) 구현.

- 알람 임계치/조합 규칙 설계, 슬랙/이메일 연동.

- 그레이드 릴리스와 롤백 플로우 자동화.

- 오프라인 평가 데이터셋 제작 및 주간 리그레션 테스트.

- 운영 핸드북·온콜 룰·사후 회고 템플릿 정착. 디지털 트렌드 읽기

마무리: 지속 가능한 품질 관리의 핵심

- AI 모델 모니터링은 “관측 → 판단 → 행동”의 반복 루프예요. 지표를 표준화하고, 자동화된 대응과 거버넌스를 접목하면 서비스 품질과 비용을 함께 최적화할 수 있습니다.

- 실무에서 가장 큰 성공 요소는 일관된 로그와 빠른 실험이에요. 내부 자료도 함께 보며 팀에 맞게 적용해 보세요. 기초 지식 정리 | 사람 이야기

- 산업 뉴스를 통해 운영 환경 변화를 꾸준히 체크해요. 이코노미스트 이슈 | 배포/운영 가이드