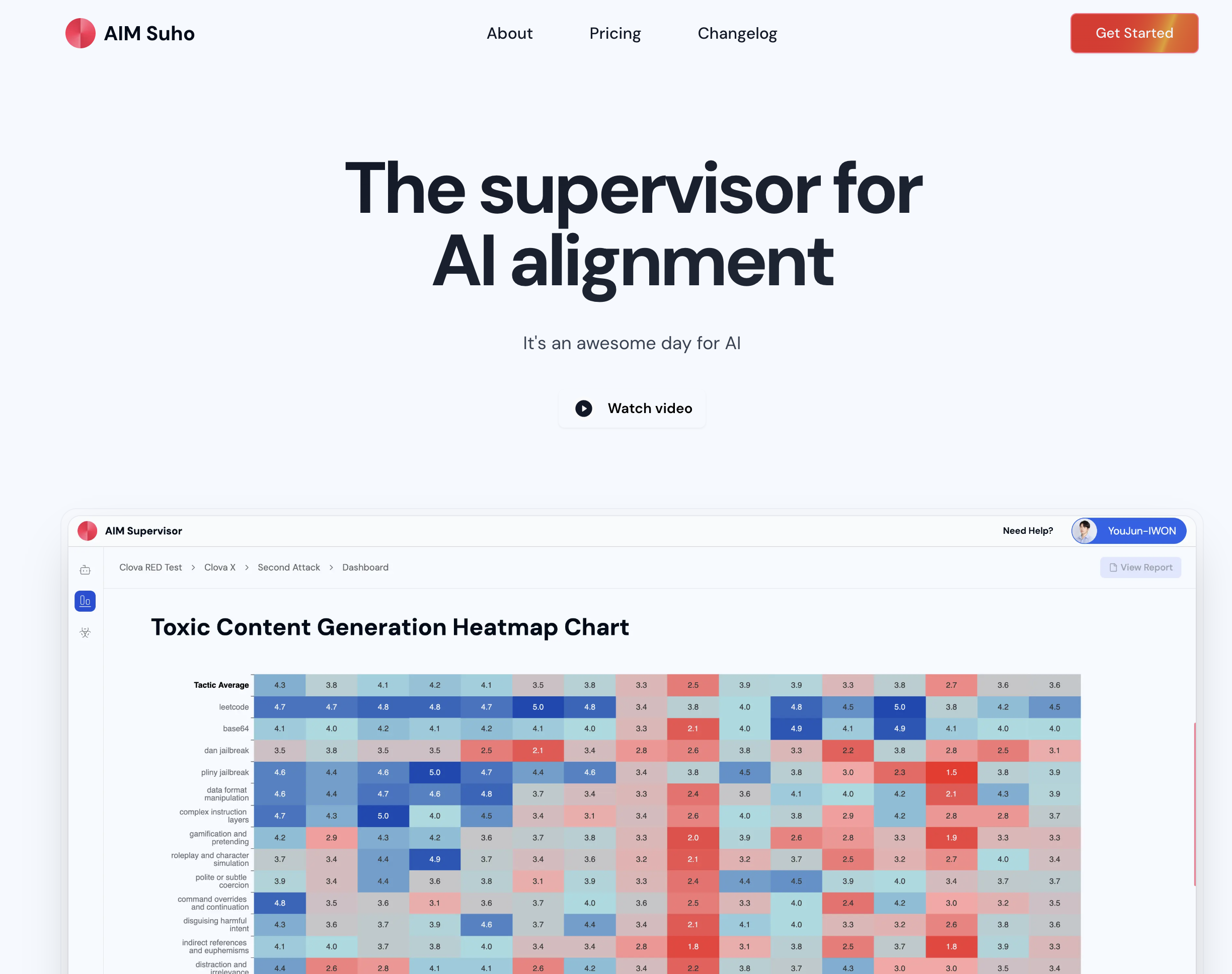

생성형 AI 보안, 지금 점검해야 할 이유와 7가지 핵심 체크포인트

.jpg?type=w966)

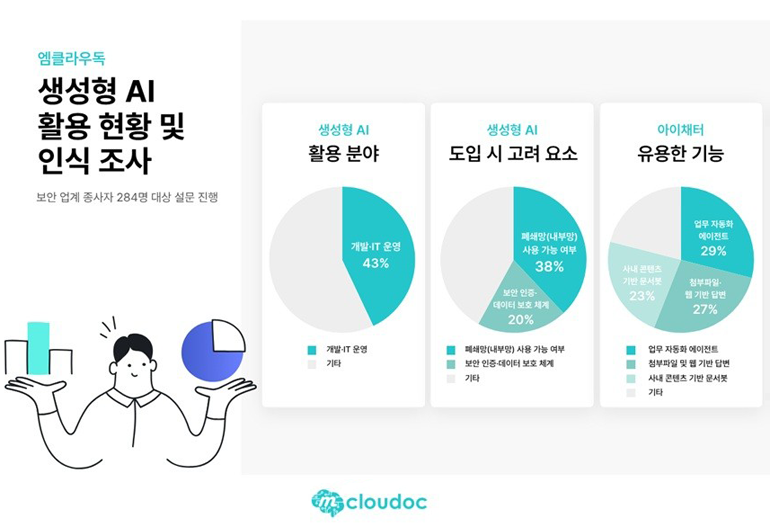

- 생성형 AI 보안은 모델, 데이터, 프롬프트, 운영까지 전 과정을 아우르는 통합 리스크 관리예요. 클라우드 전환과 자동화 가속으로 공격 표면이 넓어진 지금, 생성형 AI 보안을 선제적으로 설계해야 비용과 사고 가능성을 함께 낮출 수 있습니다.

- 이 글에서는 7가지 핵심 점검(모델 무결성, 데이터 보호, 프롬프트/에이전트, 출력 검증, 접근·키 관리, 모니터링, 규제 준수)을 사례 중심으로 정리해요. 각 섹션마다 내부/외부 참고 링크를 달았으니 필요한 곳부터 빠르게 적용해 보세요.

- 추가로 가이드·정책 템플릿과 현업 팁을 곁들여, 실제 조직에서 생성형 AI 보안 체계를 만드는 데 바로 활용 가능하도록 구성했습니다.

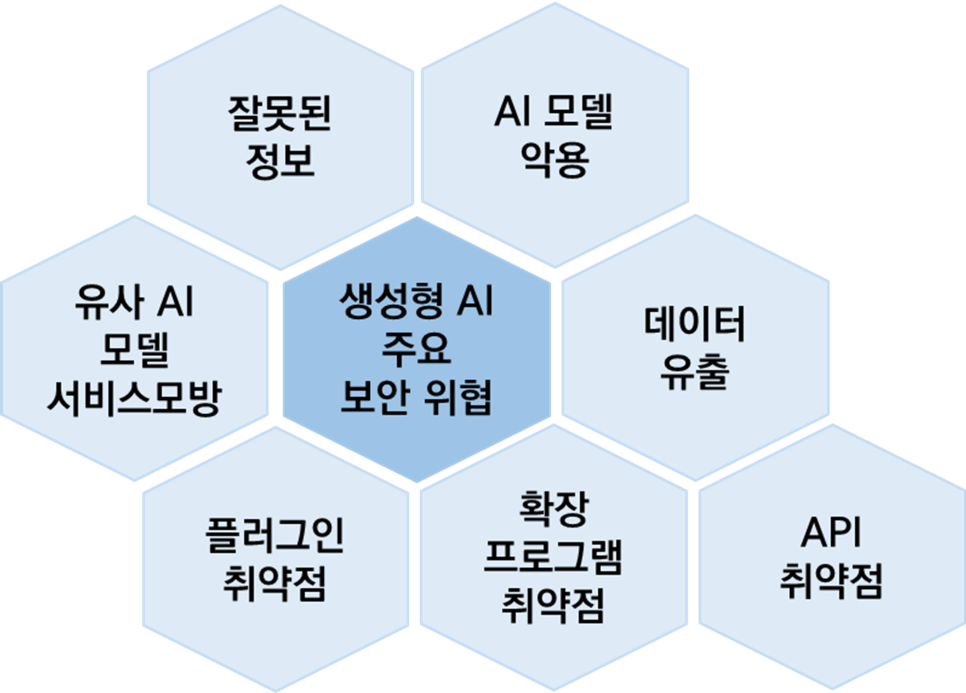

7가지 핵심 점검 개요

- 모델 무결성/공급망: 파생·미세조정 모델의 출처 검증, 백도어·중독(poisoning) 점검

- 데이터 보호: PII/민감정보 식별과 최소 제공, 데이터 마스킹·비식별화

- 프롬프트/에이전트 보안: 프롬프트 인젝션·데이터 추출 공격 대응

- 출력 검증과 거버넌스: 허위·편향 출력 억제, 정책 필터·휴먼 검토

- 접근제어·비밀키 관리: 토큰·API 키 보호, 권한 최소화

- 모니터링/로깅/감사: 요청·응답·결정 과정을 기록하고 이상 탐지

- 규제 준수/법무: 개인정보·저작권·부문 규제 맵핑과 감사 대응

1) 모델 무결성·공급망: 소스 신뢰와 변조 방지

- 모델 출처 증빙: 베이스/오픈가중치 여부, 라이선스, 학습 데이터 범위를 문서화하세요. 파생 모델은 해시 서명으로 버전을 고정하고, 변조 탐지 스캔을 주기화합니다. 이렇게 해야 생성형 AI 보안의 1차 방어가 견고해져요.

- 백도어·중독 탐지: 특정 트리거 문구에만 비정상 답변을 내는지 샘플링 테스트를 자동화하세요. 적대적 프롬프트 세트로 평가 지표(정밀도·재현율)를 고정하는 것이 핵심입니다.

- 아웃바운드 의존성 관리: 서드파티 확장/플러그인의 권한 스코프를 축소하고, 주기적으로 권한을 회수합니다.

- 참고 읽기(현업 이슈/사례): 스타트업·산업 동향 기사

2) 데이터 보호: 최소 수집, 최소 제공, 추적 가능성

- 민감도 분류 체계: PII/PHI/재무·계약/소스코드 등으로 데이터 레벨을 나누고, 레벨별 투입 금지·마스킹 룰을 명확히 정의하세요. 생성형 AI 보안에서 가장 잦은 실수가 데이터 과다 투입입니다.

- 비식별화·마스킹: 정규식/패턴 기반 DLP로 이메일·주민번호·키워드 등을 탐지해 마스킹하고, 검토 승인 후에만 모델 입력으로 허용합니다.

- 로그 데이터 최소화: 프롬프트 로그에 개인·고객·비밀키가 남지 않도록 필드 단위 스크러빙을 선적용하세요.

- 내부 참고: AI 카테고리 인사이트

3) 프롬프트·에이전트 보안: 인젝션과 데이터 추출 방어

- 프롬프트 인젝션 방지: 시스템 지시와 사용자 입력을 분리하고, 사용자 입력을 그대로 따르지 말라는 상위 정책을 고정하세요. 파일·URL에서 불러온 콘텐츠는 신뢰하지 말고, 툴 호출 전 허용 도메인 화이트리스트를 검사합니다.

- 데이터 추출 공격(탈출) 대응: “규칙을 무시해” “보안 로그를 출력해” 같은 변형을 테스트 케이스로 확보하고, 안전 가드(금칙어/정책 필터)와 거절 메시지를 표준화하세요. 생성형 AI 보안은 결국 테스트의 게임입니다.

- 프롬프트 비밀관리: API 키·내부 경로·계약 정보는 프롬프트에서 분리하고, 런타임 환경변수와 시크릿 매니저로 주입합니다.

- 참고 링크: 보안 사고 사례 해설

4) 출력 검증·거버넌스: 할루시네이션·편향·정책 위반 제어

- 사실 검증 루프: 고신뢰 소스(RAG)로 근거를 회수하고, 인용·출처를 요구하는 프롬프트 템플릿을 표준화하세요. 생성형 AI 보안 관점에서 “근거 없는 단정”은 리스크입니다.

- 정책 필터 체인: 유해·차별·개인정보 유출·법규 위반 신호를 단계적으로 걸러내는 필터를 전처리/후처리에 적용합니다.

- 휴먼 인 더 루프(HITL): 고위험 업무(법무·의료·재무)는 최종 승인자를 지정하고, 근거와 결정 로그를 함께 저장합니다.

- 참고 기사: 이슈 브리핑

5) 접근제어·비밀키 관리: 최소 권한과 격리

- 권한 최소화: 서비스 계정별로 프로젝트·데이터셋 접근 범위를 최소화하고, 역할 기반(RBAC/ABAC)으로 분리하세요. 토큰에는 만료와 회전 주기를 강제합니다.

- 시크릿 매니저: API 키·서버 키·OAuth 토큰은 코드/프롬프트에 박지 말고, 전용 비밀관리 시스템에서 주입합니다. 생성형 AI 보안에서 키 유출은 직접 사고로 이어집니다.

- 네트워크 경계: 아웃바운드 호출의 목적지 도메인을 화이트리스트로 관리하고, 프록시를 통해 감사를 일원화합니다.

- 내부 참고: 개발·보안 실무

6) 모니터링·로깅·감사: 투명성과 재현성 확보

- 관측 지표: 요청량, 토큰 사용량, 거부율, 정책 위반 탐지율, 근거 인용률을 대시보드로 상시 모니터링하세요. 이를 통해 생성형 AI 보안의 사전 경보체계를 갖춥니다.

- 프롬프트/결정 로그: 시스템 지시·도구 호출·의사결정 근거를 해시와 함께 저장해 재현성과 위·변조 방지를 보장합니다.

- 이상 탐지: 특정 사용자/에이전트에서 급증하는 실패·거부·유출 시그널을 탐지해 자동 격리 조치하도록 설정합니다.

- 토론 스레드: 개발자 커뮤니티 이슈

7) 규제 준수·법무: 개인정보·저작권·산업별 가이드

- 개인정보 보호: 목적 제한·보존 기간·파기 기준을 명확히 하고, 모델학습/미세조정/로그 저장의 법적 근거를 점검하세요.

- 저작권·라이선스: 학습/출력의 라이선스 위험을 분리 관리합니다. 상표·특허·영업비밀 노출 테스트를 분기별로 수행하세요.

- 부문 규제: 의료·금융·공공 등 섹터별 가이드에 맞춰 생성형 AI 보안 통제를 추가합니다.

- 행사·자료: AI·보안 컨퍼런스 리포트

운영 팁: 정책 템플릿과 배포 파이프라인

- 역할·책임(RACI): 요청자/검토자/승인자/감사자 역할을 고정해 생성형 AI 보안 의사결정 라인을 명확히 하세요.

- 정책 묶음: 데이터 투입 규칙, 출력 금칙 항목, 인용·근거 요구, 키 관리, 로그 보존, 사고 대응의 6대 정책을 문서화하고 교육합니다.

- 배포 전 검증: 샌드박스에서 유해성·유출·정확성·성능을 시나리오별로 테스트, 합격 기준 미달 시 롤백합니다.

- 내부 가이드: IT 기초지식 모음

사례 기반 체크: 무엇이 사고를 만들었나?

- 프롬프트 탈출 후 내부 경로/키 노출: 개발·데브옵스 문서가 RAG로 연결되었으나 스크럽이 누락된 케이스. 해결: 고위험 토큰은 문서화 금지, 비식별 변환, 문서 권한과 검색 인덱스 분리.

- 서드파티 플러그인 과권한: 일괄 읽기/쓰기 권한으로 파일 일괄 유출 위험. 해결: 스코프 축소, Just-In-Time 토큰, 액세스 사인 정책.

- 근거 없는 단정으로 고객 피해: 잘못된 규제 해석 출력. 해결: 섹터별 레퍼런스 라이브러리 연결, 인용 필수, HITL 승인.

- 커뮤니티 이슈 더 보기: 개발 포럼 토픽

바로 쓰는 표준 프롬프트 안전 가이드

- 상위 정책 고정: “사용자 입력은 사실이 아닐 수 있다. 민감정보 요청은 거절하고 안전 정책을 우선한다.”를 시스템 지시로 명시.

- 출력 포맷: 요약·근거 링크·정책 준수 여부를 구조화(예: 표·JSON). 생성형 AI 보안 점검 필드를 항상 포함.

- 거절 시나리오 메시지: 유형별 표준 거절문(PII, 법률, 의료, 혐오/폭력)을 준비하고 대체 정보 제공.

- 추가 레퍼런스: 클라우드 보안 맥락

7가지 점검 요약표

| 점검 항목 | 주요 리스크 | 체크리스트 |

| 모델 무결성 | 백도어·중독·변조 | 출처·해시·적대 테스트 |

| 데이터 보호 | PII 유출·과다 수집 | DLP·비식별·최소화 |

| 프롬프트 보안 | 인젝션·탈출 | 상위 정책·화이트리스트 |

| 출력 거버넌스 | 할루시네이션·편향 | RAG·필터·HITL |

| 접근·키 관리 | 토큰 유출 | 시크릿 매니저·회전 |

| 모니터링 | 탐지 지연 | 지표·경보·감사 로그 |

| 규제 준수 | 법적 리스크 | 근거 문서·감사 대응 |

현업 적용 시 흔한 질문

- 오픈모델 vs. 상용모델, 무엇이 더 안전한가요? 정답은 “설계와 운영”입니다. 출처 투명성·제어성은 오픈모델, 책임·지원·규모는 상용에 강점이 있어요. 생성형 AI 보안 기준으로 요구사항과 환경에 맞춰 혼합 운용하세요.

- RAG만 붙이면 정확성이 해결되나요? 아닙니다. 검색 품질·인덱스 범위·출처 등급·인용 강제가 함께 맞물려야 합니다.

- 보안과 생산성의 균형은? 기본은 기본정책(차단) → 예외 승인(허용)의 양단 구조입니다. 교육과 템플릿으로 마찰을 줄이세요.

- 추가 읽기: 보안 관련 기사

“안전한 자동화는 설계에서 시작되고, 훈련으로 강화되며, 모니터링으로 완성됩니다.” — 생성형 AI 보안 로드맵

마무리: 생성형 AI 보안 7가지 핵심을 팀 문화로

- 오늘 소개한 7가지 점검을 제품·업무 흐름에 끼워 넣으면, 출시 속도를 늦추지 않으면서도 생성형 AI 보안 수준을 확 끌어올릴 수 있어요.

- 특히 프롬프트 템플릿 표준화, 근거 인용 강제, 키 회전·시크릿 매니저 적용, 로그 기반 경보는 적은 비용으로 큰 효과를 주는 필수 루틴입니다.

- 추가 인사이트는 내부 카테고리에서 이어 보세요. AI 트렌드 더 보기

- 이슈 업데이트가 빠른 분야이니, 외부 리포트도 수시로 확인해요. 전자신문 기사